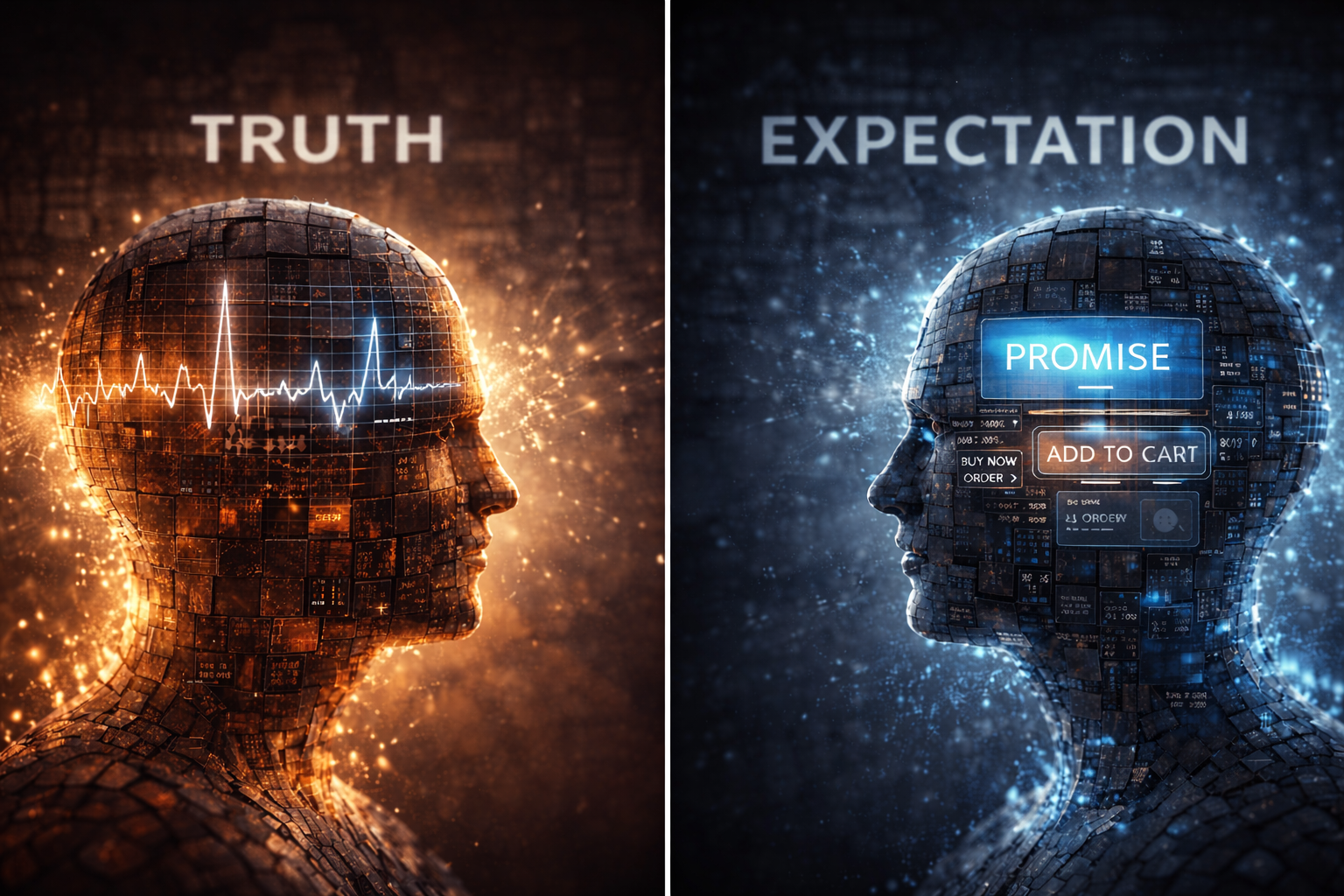

Una verdad que no es tan verdad

Nuevo paradigma dictado por la industria de las i.a.'s. Cuando un sistema promete explícitamente “tasa de refresco cada 5 horas” y luego impone bloqueos de días por regímenes opacos, no estamos ante malentendidos: estamos ante un cambio cultural donde la verdad se vuelve expectativa administrada.

Hay una diferencia crucial entre “interpreté” y “me dijeron”. Aquí no hay psicología del usuario ni malentendido: hay un enunciado explícito —“las cuotas se refrescan cada cinco horas”— y una experiencia repetida por usuarios donde la disponibilidad real se comporta como si existiera otro régimen que manda por encima del refresco. Esa contradicción no es un matiz técnico: es un problema de verdad pública.

El enunciado “se refresca cada 5 horas” aparece en la comunicación oficial para suscriptores Pro y Ultra. También aparece en la documentación de planes como “cuota… refrescada cada cinco horas”, pero acompañada de una línea que cambia todo el cuadro: límite semanal más alto. Y lo más importante: hay reportes recientes de usuarios Pro con bloqueos que exceden con creces el ciclo de horas, con fechas de reanudación que se proyectan al día siguiente o incluso varios días después.

Que una empresa tenga límites es normal. Lo que no es normal —o más bien, lo que está empezando a normalizarse peligrosamente— es que la promesa visible funcione como garantía psicológica mientras el régimen real permanece opaco o mal jerarquizado. Esa es la mutación: la verdad ya no opera como verdad; opera como expectativa.

Y cuando esta lógica se instala en productos masivos de IA, ya no estamos discutiendo un “plan mensual”: estamos discutiendo el cambio de régimen epistémico de una época.

1) De verdad a expectativa: el cambio de definición sin votación pública

La cultura occidental (con rupturas, guerras y escuelas) consolidó una intuición: verdadero significa, en algún sentido relevante, ajustado a la realidad. Eso es lo que capta la tradición de las teorías de la correspondencia: lo verdadero tiene una relación con “cómo son las cosas”.

Esa intuición no vive solo en libros: sostiene tribunales, contratos, ciencia, periodismo y vida cotidiana. Incluso cuando se miente, se presupone el patrón: mentir es desviarse de algo que existe.

El desplazamiento contemporáneo es sutil: la verdad se está degradando hacia “lo que se experimenta como confiable” o “lo que suele funcionar”. En otras palabras: verdad como sensación de estabilidad. Y ese paso ocurre sin debate, porque parece “solo tecnología”.

Pero no lo es. Es una redefinición social de lo verdadero: no como correspondencia, sino como performance aceptable.

2) Evidencia, empirismo y una obligación moral que el mercado está diluyendo

El evidencialismo —en su impulso más básico— sostiene que la creencia justificada debe ajustarse a la evidencia disponible. No es una manía académica: es una higiene mental con efectos políticos. La propia discusión contemporánea sobre ética de la creencia insiste en que cómo creemos importa, y que creer sin sustento no es inocuo.

En esa línea, W. K. Clifford formula una tesis brutalmente actual: hay un “deber de indagar”; creer con ligereza no es un pecado privado, es un daño social. Y el empirismo —desde su disputa histórica con el racionalismo— recuerda que el conocimiento del mundo requiere un anclaje serio en la experiencia, en pruebas y contrastes, no en slogans.

La IA comercial, en cambio, está empujando el movimiento inverso: nos acostumbra a vivir en un entorno donde los claims son “verdaderos” por intensidad retórica o por demo, y donde la evidencia real aparece después, fragmentada, en foros, tickets, y pantallas de “quota reached”.

Ese entorno es, filosóficamente, un entrenamiento colectivo para tolerar creencias sin evidencia suficiente —justo lo que Clifford quería evitar—, pero con una capa moderna: no se presenta como fe; se presenta como “producto”.

La discusión se vuelve más incisiva si introducimos un clásico que, paradójicamente, hoy suena como si hubiese sido escrito para el ecosistema IA: Edmund Gettier y su ataque a la definición tradicional de conocimiento como “creencia verdadera justificada”. En su breve texto, Gettier muestra que aun cuando una persona cumpla las tres condiciones —(i) la proposición es verdadera, (ii) el sujeto la cree, (iii) está justificado en creerla—, puede ocurrir que no haya conocimiento, sino solo una verdad alcanzada por caminos defectuosos, donde la coincidencia y la suerte hacen el trabajo final.

Gettier no está siendo sofisticado por deporte: está clavando una cuña moral en el corazón de la epistemología moderna. Su punto es que la “justificación” puede convivir con la falsedad (puedo estar justificado en creer algo falso) y que, además, la justificación “se hereda” por inferencia: si creo P con buena evidencia y P implica Q, entonces también puedo estar justificado en creer Q —aunque la ruta que me llevó a Q esté contaminada por un supuesto falso. Ese mecanismo produce una patología que hoy es estructural en sistemas y mercados: creencias justificadas que llegan a una frase verdadera por razones equivocadas.

Este es el filo: si “verdad + justificación” puede fallar como conocimiento, entonces un mundo que vende experiencias de verdad —interfaces que suenan justificadas, marcas que se presentan como autoridad, modelos que producen plausibilidad— está fabricando, por diseño, una cultura Gettierizada: mucha afirmación “bien vestida”, ocasionalmente verdadera, pero incapaz de constituir un suelo firme de conocimiento.

3) Por qué la carrera entre IA's convierte el lenguaje en arma y la verdad en daño colateral

La competencia acelerada entre plataformas crea un incentivo estructural: anunciar primero y estabilizar después. No porque “sean malos”, sino porque el mercado premia la ventaja narrativa.

En ese clima, las empresas aprenden a vender:

- capacidades como horizonte (lo que “ya casi” hace),

- nombres con agencia (que sugieren autonomía),

- promesas con letra variable (verdaderas en un plano, falsas en la experiencia).

El caso de los límites no es un accidente: es la forma natural en que se administra un recurso escaso (cómputo) dentro de una competencia feroz, pero maquillándolo como continuidad garantizada. Cuando el sistema promete 5 horas y luego te bloquea por días, lo que colapsa no es tu “interpretación”: colapsa el contrato semántico básico entre afirmación y realidad.

Y esto escala: cuando la verdad se hace elástica en productos de IA, la elasticidad se vuelve un estilo cultural.

4) El “engaño por jerarquía”: cuando la frase cierta está puesta para que entiendas otra cosa

Aquí conviene ser preciso y duro.

- Si un sistema declara “refresco cada 5 horas” como mensaje dominante, la mente humana —sin inferir nada sofisticado— entiende una regla práctica: el castigo máximo es esperar horas.

- Si existe un régimen adicional (semanal u otro) que puede imponerse como bloqueo multi-día, entonces el mensaje dominante funciona como señuelo: no porque sea literalmente falso en aislamiento, sino porque está diseñado para producir una expectativa que el sistema no respeta consistentemente.

Esto es lo que en ética de la creencia importa de verdad: no basta con que una frase sea defendible; importa si induce creencias razonables sin entregar la evidencia relevante.

Y cuando esa inducción está ligada a un pago mensual, el problema deja de ser “filosófico” en el sentido ornamental. Es un problema de verdad contractual: se compra una realidad, se entrega otra, y el usuario se entera después.

La analogía con Gettier aquí no es ornamental: ayuda a describir una modalidad contemporánea de engaño que no requiere negar la verdad, sino administrar su interpretación. El sistema puede decir algo literal y, aun así, inducir una creencia práctica equivocada porque oculta el régimen realmente decisivo. En clave gettieriana: el usuario queda en una posición donde su “creencia” puede estar “justificada” por la comunicación oficial, y sin embargo no posee conocimiento operacional de lo que efectivamente ocurrirá, porque hay una condición relevante no disponible o mal jerarquizada.

Y este detalle importa porque muestra un salto cualitativo del marketing tecnológico. En el marketing clásico, el riesgo era la mentira frontal (prometer lo que no existe). En el paradigma actual, el riesgo dominante es más sutil: decir una verdad parcial con autoridad suficiente para que el público complete el resto. El “refresco cada 5 horas” se vuelve, entonces, una pieza de ingeniería de expectativas: funciona como garantía psicológica aunque exista un mecanismo de bloqueo largo que redefine, en la práctica, el significado de esa promesa.

Gettier lo anticipa con un diagnóstico filosófico que hoy es social: la verdad puede aparecer como resultado sin que el sistema que la genera sea confiable. Una institución puede producir resultados correctos por accidente; una explicación puede sonar sólida y acertar por casualidad; una cuota puede “refrescar” y, sin embargo, quedar subordinada a un límite oculto que decide la disponibilidad real. Cuando eso se normaliza, la sociedad aprende una lección tóxica: lo importante no es comprender el régimen, sino navegar sus señales superficiales.

5) No es un caso aislado: el mercado ya está llenándose de “IA-washing”

No hace falta adivinar intenciones; basta mirar el patrón. En Estados Unidos, la Federal Trade Commission ha anunciado operativos y acciones contra afirmaciones engañosas vinculadas a IA (“deceptive AI claims”), precisamente porque la ola de hype se convirtió en una infraestructura para la estafa y el marketing falso.

Este dato es importante por una razón: la autoridad no está discutiendo “si la IA es difícil”. Está diciendo algo más viejo: la tecnología no suspende la obligación de decir la verdad.

Entonces el propio mercado necesita que el regulador recuerde esa obviedad, es porque el ecosistema ya cruzó un umbral cultural: el de la promesa como moneda.

6) El núcleo del paradigma: “verdad” ya significa “lo que puedo esperar del sistema”

Este es el giro peligroso.

En un mundo sano, “verdadero” es un estándar que limita el discurso. En el mundo que está naciendo, “verdadero” se reinterpreta como:

- “lo que normalmente hace”,

- “lo que a veces hace muy bien”,

- “lo que el plan sugiere que hará”,

- “lo que el roadmap promete”.

Esto transforma a la verdad en un objeto psicológico: una expectativa administrada por marca, interfaz y competencia. Y en ese punto, la sociedad empieza a vivir en un régimen donde la verdad no se demuestra: se experimenta.

La IA generativa lo potencia porque produce plausibilidad con soltura: su salida puede sonar cierta incluso cuando no lo es. El resultado cultural es una inflación de afirmaciones con estética de verdad.

Si quieres la frase corta (para que quede como tesis del ensayo):

La mentira contemporánea no siempre necesita negar los hechos: le basta con vender el horizonte.

El verdadero daño cultural no es solo la frustración del usuario; es la mutación silenciosa del estándar de conocimiento. Gettier destruye la complacencia de “si es verdad y está justificado, entonces lo sé”. Y esa destrucción, trasladada al presente, ilumina un peligro específico de la carrera entre IAs: estamos aprendiendo a aceptar como “saber” lo que en realidad es salida verosímil, “justificación” performativa (tono seguro, branding, supuestas garantías), y, en el mejor de los casos, acierto por correlación o suerte.

En un mundo gobernado por modelos que optimizan plausibilidad y por empresas que optimizan adopción, la epistemología se vuelve un problema de diseño de incentivos: ¿qué se premia, la correspondencia o la convincencia? Gettier nos obliga a formularlo con crudeza: si multiplicamos sistemas que producen “creencias verdaderas justificadas” sin entregar conocimiento (porque el acierto depende de condiciones opacas o de casualidad), entonces no solo degradamos la publicidad; degradamos el criterio cultural de lo que cuenta como verdad.

Y a futuro, el riesgo es que la civilización cambie de lengua sin darse cuenta: llamará “verdad” a lo que es, en rigor, expectativa gestionada con alta tasa de acierto, y llamará “conocimiento” a lo que es resultado sin control sobre las condiciones que lo hacen posible. Ese desliz es el paradigma: no un error puntual, sino una redefinición práctica de la verdad bajo presión competitiva.

7) Qué deberíamos exigir: no menos innovación, más verdad

No se trata de frenar IA. Se trata de impedir que “IA” se convierta en excusa para degradar el lenguaje.

Tres exigencias mínimas, compatibles con la innovación:

- Claims medibles, no adjetivos. Si dices “refresco 5 horas”, debes mostrar el otro régimen que manda (semanal, capacidad, etc.) de forma visible y cuantificada.

- Condiciones de degradación explícitas. “En alta demanda, puede aplicarse límite semanal y bloquear por X–Y días”. Lo contrario es vender continuidad sin sostenerla.

- Ética evidencialista aplicada al marketing. No afirmes lo que no puedes sostener con evidencia pública. Este punto no es “purista”: es civilizatorio.

Cierre: lo que está en juego no es una cuota, es el estándar humano de verdad

La humanidad puede vivir con incertidumbre. Siempre lo hizo. Lo que no puede —sin pagar un precio altísimo— es vivir con un lenguaje donde “verdad” significa “quizás, depende, mañana, en otro plan, con otro límite”.

Luego la industria dicta el nuevo significado de verdad como expectativa, no solo cambia el mercado: cambia la cultura. Y una cultura que renuncia a la verdad como estándar termina gobernada por la retórica, no por la realidad.

Eso sí que es un cambio de paradigma.

Bibliografía mínima (orientativa)

Clifford, W. K. 1877. “The Ethics of Belief”.

Gettier, Edmund L. 1963. “Is Justified True Belief Knowledge?” Analysis 23 (6): 121–123.

Stanford Encyclopedia of Philosophy. Entradas: “Truth (Correspondence Theory)”, “Ethics of Belief”, “Rationalism vs. Empiricism”.

Federal Trade Commission (FTC). 2024. Acciones contra afirmaciones engañosas sobre IA (“deceptive AI claims”).